21. Februar: Wie Algorithmen diskriminieren – und was wir dagegen tun sollten

Anhand von konkreten Fallbeispielen beleuchten wir unterschiedlichste Fälle von algorithmischer Diskriminierung.

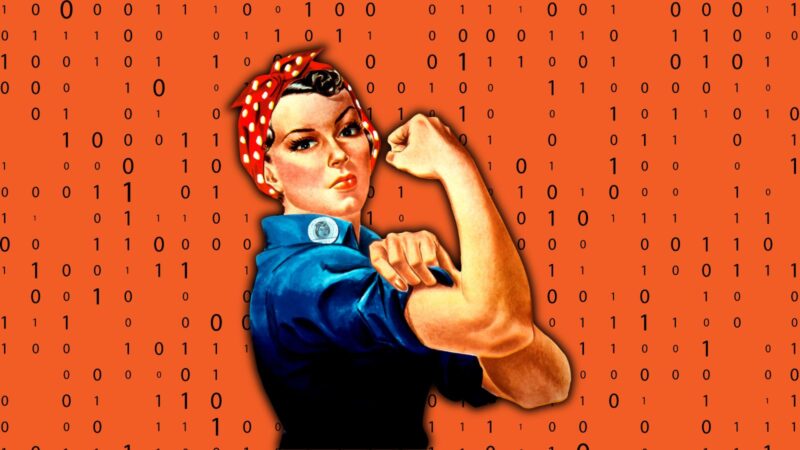

Algorithmen sind weder neutral noch objektiv. Wenn algorithmische und KI-basierte Systeme von Behörden und Unternehmen eingesetzt werden, um Prognosen zu erstellen, Empfehlungen abzugeben oder Entscheide zu fällen, kann dies zu Ungerechtigkeiten und Diskriminierungen führen.

An ausgewählten internationalen Tagen machen AlgorithmWatch CH und humanrights.ch zusammen mit weiteren Organisationen auf Diskriminierungen bestimmter Bevölkerungsgruppen im Zusammenhang mit dem Einsatz von Algorithmen und sogenannter Künstlicher Intelligenz aufmerksam.

Algorithmische Diskriminierung in der Schweiz: Der bestehende Diskriminierungsschutz in der Schweiz bietet keinen wirksamen Schutz vor Diskriminierung durch algorithmische Systeme und muss verstärkt werden. In diesem Positionspapier schildern wir die Herausforderungen, die algorithmische Diskriminierung mit sich bringt, und beschreiben, wie der Diskriminierungsschutz verbessert werden kann.

AlgorithmWatch CH ist eine Menschenrechtsorganisation, die sich dafür einsetzt, dass Algorithmen und Künstliche Intelligenz (KI) Gerechtigkeit, Demokratie und Nachhaltigkeit stärken, statt sie zu schwächen. Abonniere hier die AlgorithmNews CH.

humanrights.ch informiert, berät und stärkt diejenigen, die sich für ihre eigenen Menschenrechte und für die Menschenrechte anderer einsetzen – in der Öffentlichkeit, in der Politik, in der Justiz, in Organisationen und Bewegungen, in der Bildung. Abonniere hier die Newsletter von humanrights.ch.